Is de magie uitgewerkt?

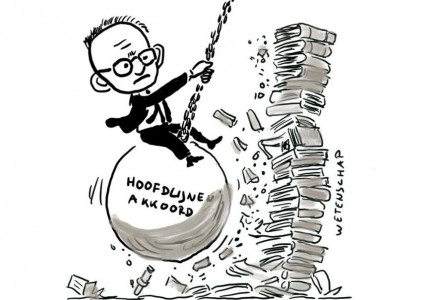

COLUMN - Ook wat zorgelijk is, kan interessant zijn. Wat er nu allemaal met de wetenschap gebeurt, stemt tot vrees, jazeker, en tot ontevredenheid. Maar zeker ook tot nadenken.

De essayist en hoogleraar Slavische letterkunde Karel van het Reve (1921-1999) heeft eens geschreven over het wonderlijke feit dat mensen die nooit naar het Concertgebouw gingen bereid waren om toch mee te betalen aan het Concertgebouw. We kunnen constateren dat aan dit wonder langzamerhand een einde komt: een heel grote groep mensen is steeds minder bereid te betalen voor kunst en cultuur. Laten die linkse lui met hun grijze haar in een scheiding en koninklijke onderscheidingen op hun revers dat allemaal zelf maar betalen!

De wetenschap en vooral het hoger onderwijs waren lange tijd uitzonderingen op die regel. Ik denk dat dit er minstens deels mee te maken heeft dat heel veel mensen hun kinderen of kleinkinderen graag een hogere opleiding gunnen – daar kun je immers een goede baan mee krijgen.

Maar aan dat idee komt nu langzamerhand ook een eind. Niet alleen zie je dat aan de vrij moeiteloze manier waarmee mensen kennelijk aanvaarden dat er afgebroken wordt (de CDA-achterban komt niet in opstand vanwege de harde bezuinigingen waarin hun partij ook meestemt). Maar ook blijkt het aantal studenten dat zich bij de universiteiten inschrijft de laatste jaren af te nemen – en dat kan niet alleen geweten worden aan demografische ontwikkelingen.