Hoe weinig ontwikkeld ze ook zijn, we kunnen de assistenten en bots op dit moment wel degelijk beschouwen als een soort robots waar we in de toekomst nauw mee gaan samenwerken, -wonen en –leven. Een update over chatbots en virtuele assistenten.

De afgelopen twee jaar zijn zowel spraakherkenning als spraaksynthese enorm verbeterd. Ook het aanbod aan spraakgestuurde systemen, dat twee jaar geleden nog werd gedomineerd door Siri, Cortana en Google Assistant, heeft zich verder ontwikkeld: zo is in twee jaar tijd Amazon’s Alexa marktleider geworden. Het enige wat nog ontbreekt is begrip van de context – een absolute voorwaarde om spraakbesturing echt tot een leidende technologie te maken.

Spraakherkenning heeft een nauwkeurigheid bereikt waarbij het verschil met mensen grotendeels is weggevallen. De Chinees-Engelse vertaalmachine iFlytek maakt minder dan 2 procent fouten, mede dankzij de 4,5 miljard spraakfiles die per dag aan het systeem worden toegevoegd. iFlytek is een startup uit 1999, opgezet door een doctoraalstudent van een regionale universiteit in Hefei, China. Ook Google haalt met gemak 95 procent. Maar de grootste stap voor spraaktechnologie moet nog gezet worden. En dat is de stap naar grootschalige toepassing door consumenten, bijvoorbeeld door het gebruik van virtuele assistenten.

Ecosystemen in aanbouw

Hoewel drie van de vier platformen (Siri, Cortana en Google Assistant) al enige tijd aanwezig zijn, heeft met name de komst van Amazons Alexa voor een versnelling gezorgd. In de consumentenmarkt is zichtbaar dat de ecosystemen rondom de spraakassistenten groeien. Amazon’s Alexa werkt naadloos samen met andere hardware (denk aan Sonos of Hue), met online contentplatformen zoals Spotify en met digitale platformen zoals IFTTT. Naast de samenwerkingsverbanden met hardwareproducenten (waarmee ongemerkt het Internet of Things tot stand komt) kennen de assistenten ook ‘skills’ (Alexa) of ‘actions’ (Google) – geautomatiseerde interacties die met een druk op de knop aangezet kunnen worden. Zo kan Alexa op verzoek boeren laten of zelfs een boerwedstrijd organiseren, maar er zijn ook nuttiger skills zoals ‘find my phone’. Ook de concurrenten van Amazon werken ondertussen hard aan hun eigen ecosystemen, maar Amazon heeft met de meeste skills een voorsprong.

Goed in spraakverwarring

Deze ontwikkelingen wekken de indruk dat spraakgestuurde interacties met systemen goed verlopen, maar de werkelijkheid is anders. Google, Alexa of Siri missen nog steeds de intelligentie om de context te begrijpen, wat zichtbaar wordt in een demo waarbij Google, Alexa en Siri elkaar niet herkennen als ‘collega’s’ en evenmin begrijpen dat ze bij hun groepsgesprek in een oneindige loop belanden. Daar staat tegenover dat spraakassistenten er prima in slagen om onderling volkomen abstracte dialogen aan te gaan. Ook het geven van gevatte antwoorden op lastige vragen (de zogenaamde easter eggs) is voor de meeste systemen geen probleem. De assistenten gaan ook de mist in als ze moeten luisteren terwijl mensen door elkaar (of door muziek) heen praten. Zo is Alexa uitstekend in staat om op verzoek een specifieke Spotifytrack af te spelen, maar is ze tijdens dat afspelen wel slechthorend: wil je Alexa vragen naar het volgende nummer te zappen, dan moet je je stem verheffen.

Hardware gedreven

Anders dan Alexa zijn Siri en Google ingebouwd in smartphones, tablets en pc’s en dat zou een voordeel kunnen zijn, ware het niet dat Siri op je mobiele device niet met spraak geactiveerd kan worden. Siri’s spraak klinkt bovendien minder goed dan die van Alexa (dat kan verklaard worden doordat Alexa zich tot de grotere talen beperkt terwijl Siri ook Nederlands spreekt). Siri heeft daarnaast de sterke neiging om als respons op een vraag met een webpagina te komen – begrijpelijk omdat Siri deel uitmaakt van apparaten met een scherm. Het verschil tussen Siri en Alexa komt ook op een andere manier tot uiting: Alexa is (als los apparaat) een verkoop-hit, terwijl Siri ‘ontdekt’ moet worden in een Apple device.

Hooggespannen verwachtingen

Of het nu met of zonder spraak is, de verwachtingen ten aanzien van geautomatiseerde dialogen zijn enorm. Capgemini verwacht dat de spraak-assistent in retail de komende drie jaar een ‘dominante factor’ wordt in de klantinteractie. De verwachtingen zijn hooggespannen en leiden dan ook tot hysterische uitspraken als “Klanten die een spraakgestuurde assistent gebruiken, zijn bovendien bereid om tot 500% meer uit te geven dan tot nu toe het geval is via deze vorm van interactie.” Die hooggespannen verwachting is vooral gebaseerd op voorkeuren van consumenten en dus niet op gedrag: grofweg een kwart (24%) van de respondenten gebruikt tegenwoordig liever een spraakgestuurde assistent dan een website, aldus de onderzoekers. De komende drie jaar zal dit percentage stijgen tot 40%. Cap brengt de toename in het verwachte gebruik van spraakassistenten direct in verband met een verdere daling van het bezoek aan winkels. Met een spraak-assistent kan je immers online aankopen doen – het is online shoppen, maar dan spraakgestuurd. Volgens Cap gebruikt op dit moment een derde van de respondenten (35%) spraakgestuurde assistenten voor het doen van boodschappen en de aanschaf van huishoudelijke artikelen of kleding. Andere populaire uitgaven zijn het bestellen van een maaltijd (34%) en het doen van betalingen (28%).

Bankkantoor vervangen door chatbot

De hype rondom chatbots en virtuele assistenten moet met de nodige relativering moet worden bekeken. In Zweden hebben de grootste banken hun kantorennetwerk uitgedund en ingezet op chatbots. Hoe blij consumenten ook zijn met de mogelijkheden rondom selfservice en online bankieren, in Zweden was het eindresultaat in ieder geval niet dat de klanttevredenheid toenam. Het kunnen identificeren van de klant, het begrijpen van de vraag en het herkennen van emoties is allemaal mogelijk, maar niet voldoende.

Het aangaan van een volwaardige, dus betekenisvolle dialoog blijft namelijk nog een hele uitdaging. Allereerst: het enige verschil tussen spraakgestuurde assistenten zoals Siri en Alexa en een chatbot is dat de chatbot tekstgebaseerd werkt – de vertaalslag van spraak naar tekst blijft achterwege. In het bedrijfsleven wordt al gesproken over conversational service en conversational commerce, maar chatbots zijn nog niet in staat tot een dialoog.

Chatbots zijn nog behoorlijk dom

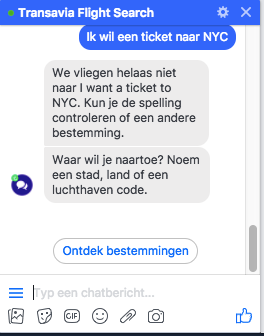

De intelligentie beperkt zich tot het begrijpen van de ingevoerde vraag en het genereren van het bijbehorende standaardantwoord (eventueel voorzien van klantgerelateerde gegevens die uit systemen worden opgehaald, denk aan boekingen of bestellingen). Zelfs chatbots die verder doorontwikkeld zijn, zoals Mitsuku, lopen gemakkelijk vast (of eindigen met standaardantwoorden) omdat ze niet met context kunnen omgaan. Een goed voorbeeld van gebrek aan intelligentie is de chatbot van Transavia, die via Facebook Messenger aangeeft dat je ‘direct kunt starten’. Als je een vraag intikt in het Nederlands, komt er eerst een vraag in welke taal je wilt communiceren. Als je geen antwoord geeft, komt de chatbot ook niet met eigen initiatief; als je een ticket naar NYC vraagt, laat de reactie zien hoe de bot werkt.

Chatbots en virtuele assistenten kunnen nog niet anticiperen, ze kunnen niet creatief denken, niet zelf bepalen uit welke systemen ze welke informatie moeten halen, niet bepalen welke controlevragen ze moeten stellen in welke situatie. Soms is het zelfs nodig om te weten wie (in een bepaalde ruimte met meerdere sprekers) iets zegt.

Wachten op contextgevoelige AI

Kortom, bots missen het vermogen om context te kunnen begrijpen. Context is ook het tussen de regels door kunnen lezen en het kunnen combineren van eerder vergaarde kennis of elders aanwezige kennis of informatie. Veel van die informatie is wel beschikbaar, maar niet gemakkelijk te vinden, laat staan bruikbaar. Aan een klant vragen of het hotel kindvriendelijk moet zijn heeft geen zin als de chatbot had kunnen weten dat de klant geen kinderen heeft: bijvoorbeeld uit een eerdere conversatie of uit klantgegevens. De vraag ‘wie van mijn vrienden is wel eens op Corsica geweest?’ is bijvoorbeeld te beantwoorden met een check van Facebook, maar de kans dat op deze manier een sluitend en correct antwoord wordt gevonden, is niet zo groot. De ontwikkelaars van Ally Assist van Ally Bank hebben wel geprobeerd toe te werken naar een ‘gecontextualiseerde user experience’. Klanten van de Ally Bank hebben de optie om te chatten of te spreken en Ally Assist houdt rekening met eerdere interacties. De assistent onthoudt eerdere vragen (en antwoorden) en presenteert informatie op maat. Zelfstandige virtuele agents zoals Alexa moeten het doen met een internetverbinding en de opgeslagen dialoog. Alexa is bijvoorbeeld niet in staat om als stand alone oplossing aan technische trouble shooting te doen.

Context: grote technologie-uitdaging

Het is vooral deze veelheid aan context die gedurende een conversatie kan veranderen die het lastig maakt: in welke systemen moet de chatbot zoeken? Omgekeerd geldt voorlopig de wet dat een chatbot beter is in zijn taak als dat een gespecialiseerde taak is.

Het betekent ook dat we de komende jaren veelvuldig te maken zullen krijgen met chatbots en virtuele assistenten die ons proberen te helpen, maar daar volstrekt in falen. Daarom is dit artikel van Arjan van Hessen (Telecats/TU Twente) relevant: hij vraagt zich af of het niet tijd wordt voor fatsoensregels voor onze omgang met virtuele assistenten. Alexa kan je het zwijgen opleggen door te zeggen ‘Alexa, stop’, maar ‘Alexa, shut up’ werkt even goed. Hoe weinig ontwikkeld ze ook zijn, we kunnen de assistenten en bots op dit moment wel degelijk beschouwen als een soort robots waar we in de toekomst nauw mee gaan samenwerken, -wonen en –leven.

Verscheen eerder op Toii.